呪文をいれればAIイラストがあっという間に作れる。今話題のAIイラスト。現在主流となっているものは、3つ。それぞれ色々な特徴があるので違いを詳しく解説してゆきます。

DALL·E 2

AIイラスト本家本元であるDALL·E 2 は、artificial intelligence (AI)モデルで、Promptベースの文字から絵を既成することができるAIアートジェネレータです。GPT-3でも有名な、OpenAIが開発したものになります。1024×1024 ピクセルの正方形が現在最高水準の画像となっており、オリジナルのDALL·Eバージョンの時の 512×512 ピクセルを大幅に改善したモデルになっています。文章を入力することで、簡単に素敵な絵を誰でも出力することができます。

DALL·E 2は有料となっており、使っただけ課金されるオンディマンド課金方式になっています。3つの解像度で課金スタイルが変わります。

1024 ×1024 $0.020 / image

512 x 512 $0.018 / image

256 x 256 $0.016 / image

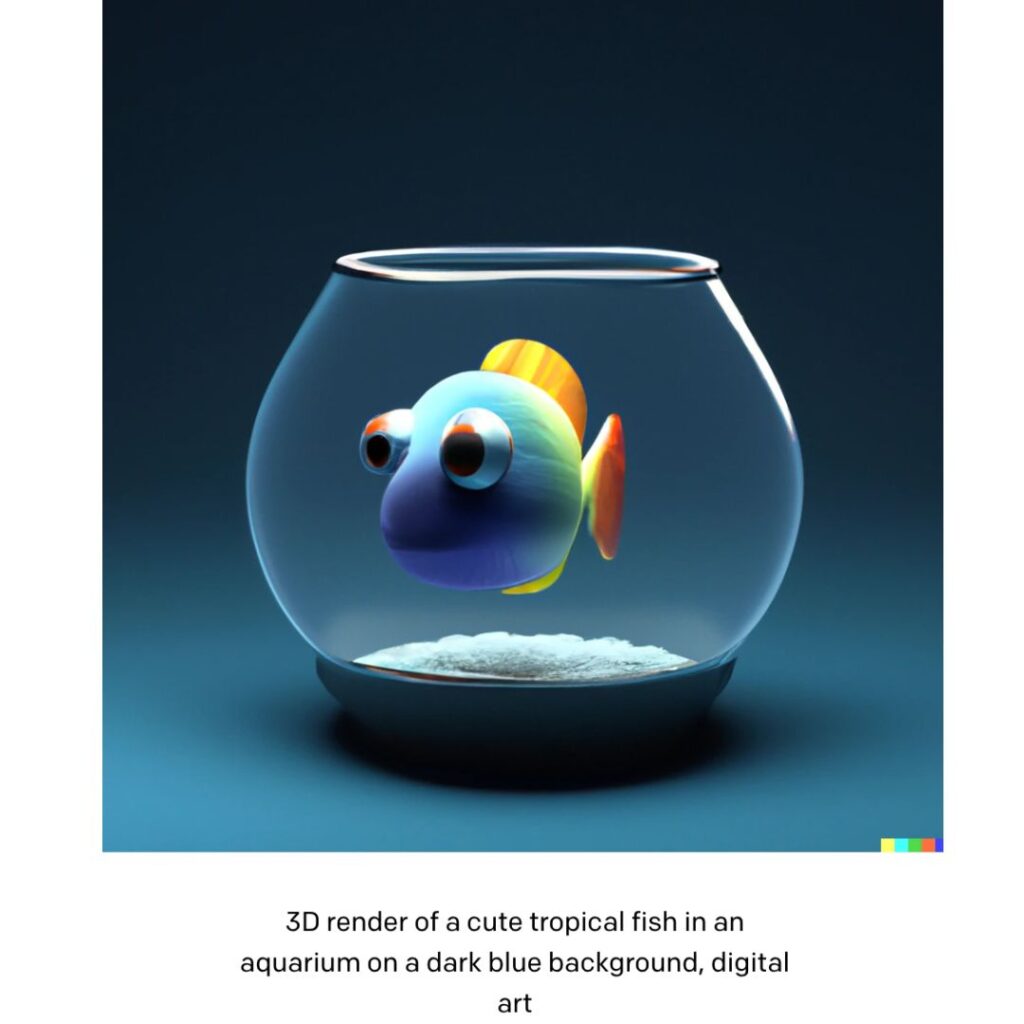

DALL·E 2のサイトから直接画像の作成ができます。毎月無料トークンが配られているので、試してみてください。400文字までの英文を入力します。日本語でもできますが、AIモデルは英語が主言語なので、英語単語の方がより洗礼された画像を作ることができます。試しに以下の文をコピペするとこのような画像が出るとなっていますが、

3D render of a cute tropical fish in an aquarium on a dark blue background, digital art

OpenAI HP

実際に出たのはこんな感じ。同じ文字列をいれても同じ画像は出てきません。画像は唯一無二のもので、seedと呼ばれる特別な番号を指定しない限り、同じものは出力されません。ある意味ガチャですので素敵な画像が出た場合は、保存しておきましょう。

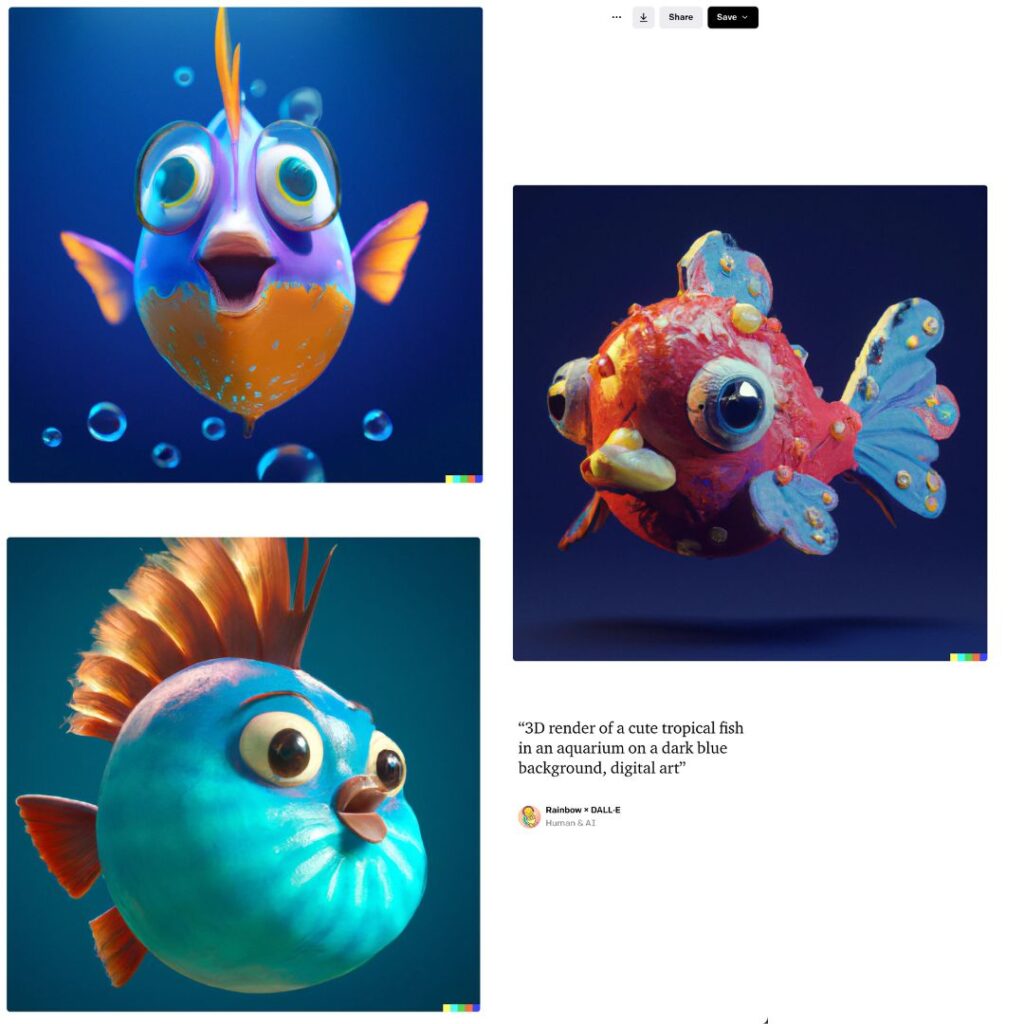

シンプルな文章をちょっと複雑にするとこんな感じの絵を出すこともできるようになります。英文がかなり長くなりましたが、細かく書けば書くほどこのように詳細な画像になってきます。

An adorable Japanese anime-style tropical fish swims in a bright, colorful aquarium filled with playful decorations. The fish has large, expressive eyes and a sleek, stylized body. Its scales are a bright, vibrant orange with pops of pink and yellow. The aquarium is decorated with whimsical elements like a tiny treasure chest, a shipwreck, and a sunken castle. The dark blue background gives the image a dreamy, underwater feel.

DALL·E 2は、OpenAIの人がチューニングしているので、絵の感じも海外っぽいのが出てきます。Japanese anime-styleを入れることでかなり可愛らしくなりましたよね。このように文字列をコントロールしながら思い通りの絵を作り上げてゆくのがPromptの役割になります。

Stable Diffusion

Stable Diffusionは、DALL·E 2と並ぶ最も有名なAI アートジェネレータです。DALL·E 2と同様Promptから画像を作ることができますが、厄介なのはDALL·E 2と同じPromptを入れても同じ結果になりません。DALL·E 2は、語彙力をつかってAIモデルに話しかけるのに対し、Stable Diffusionは、キーワード的な要素をつなげてProomptを作成します。

例えば、

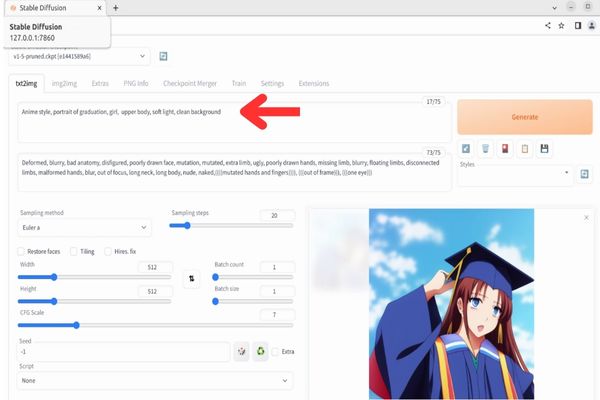

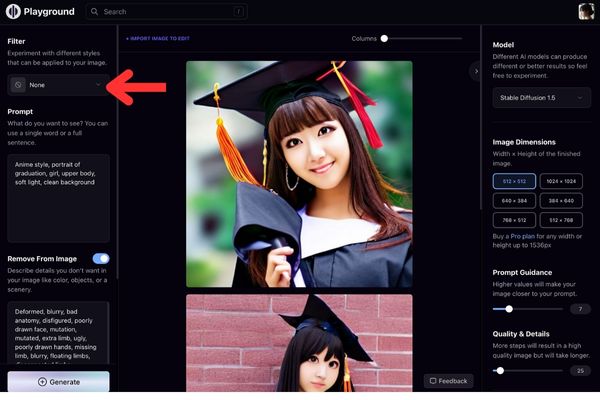

Anime style, portrait of graduation, girl, upper body, soft light, clean background

と入力すると、このような画像を出すことができます。これもガチャで何が出るかはわからない。つまり出力を重ね、やっと気に入ったものが出てきて保存。という作業を繰り返すようになります。

最終的には、こんな可愛くすることもできます。フィルターを入れていないStable Diffusion では、いかに語彙を使って正確な画像を引き出すかがキーワードになってきます。

Stable Diffusionを使う方法は2つあります。

1.自分でコンピュータを用意しWEB UIを入れる (Automatic 1111が有名です。)

このようなWEB UIを利用すると細かいチューニングや調整ができます。コミュニティーも充実しており、DreamShaperというようなチューニングを入れるだけで、簡単にこのような素敵な画像も出せるようになります。

Created by DreamShaper

2. Playground AI サイトを利用する。

こちらの方法は、一番簡単に始められる方法です。あらかじめ用意されたフィルターがあるので誰でも簡単に素敵な画像を出すことができるようになります。Googleのアカウントがあればすぐに始められます。

Playground AI は、Stable Diffusion 1.5, 2.1 がWEB上で使えるサービスです。Promptに先ほどと同じ文字列を入れるとアニメにならずいうことを聞いてくれません。(聞いてくれる時もあります。)

Anime style, portrait of graduation, girl, upper body, soft light, clean background

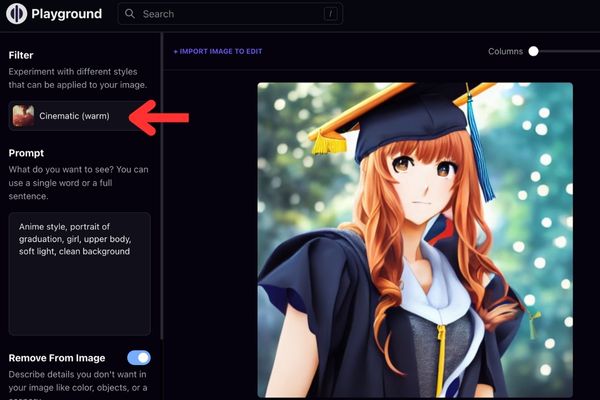

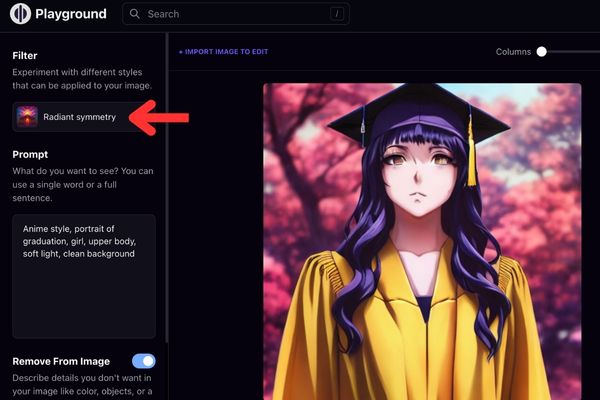

そこで、Filterから自分の好きなものを選んで同じ文字列で出力すると、こんな感じに生まれ変わります。

左下にある、Remove from Imageというボタンをオンにすると画像に出力したくないPromptを書き込めます。Stable Diffusionでは、PromptとNegative Promptがワンセットになっていて、画像を調整するようになります。

Stable Diffusionでは、DALL·E 2とは違いNegative Promptが必要になります。画像に表示したくないものを指定してゆきます。

基本的なNegative Prompt を置いておきますので追加して使うとより鮮明な画像を作り出せます。(以下はPromptには入れないようにしてください。Negative Promptは、出したくないという否定するPromptなので、Promptのところに入れてしまうと顔の崩れた変な写真が出てきてしまいますので注意してくださいね。)

Deformed, blurry, bad anatomy, disfigured, poorly drawn face, mutation, mutated, extra limb, ugly, poorly drawn hands, missing limb, blurry, floating limbs, disconnected limbs, malformed hands, blur, out of focus, long neck, long body, ((((mutated hands and fingers)))), (((out of frame))), (((one eye)))

同じ文字列でもフィルターを変更するだけで、仕上がりがかなり違います。

Stable Diffusionは、オリジナルでその上にどんどん装飾できるフィルターを追加しながら綺麗な画像に仕上げてゆくことができます。Plaryground AI ですと決まったフィルターのみですが、自分で機器を用意しAutomatic1111のようなWEB UIを導入すれば自分の好みのフィルターを入れられる他、自分でモデルのトレーニングもすることができるようになり、かなり高度なことができるようになります。

高度なことができる例としては、自分のモデルをトレーニングすること。例えばペットの顔をトレーニングして、着物を組み合わせると、こんな画像も作れます。これは、友人の猫の顔をトレーニングし、着物コレクションをトレーニングし、掛け合わせて作ったものです。Stable Diffusionで作成しています。

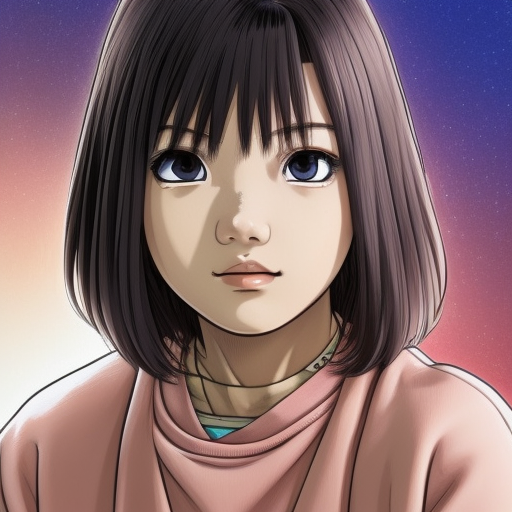

また、人の顔のトレーニングもできます。自分の顔をトレーニングし映画風のフィルターにかければこんな感じの素敵な写真も作れます。

自分の写真をトレーニングすると、アニメ、スケッチ風、モデル風、映画風などさまざまなシーンで出力ができるようになります。お気に入りがこんなふうに出てきたら、100種類の全く違う子を今度は、image to image という手法で作ることができます。この手法はNFTとも相性が良く、コレクション形式で画像出力することができるようになります。

なんといっても、Stable Diffusion とDALL·E 2との大きな違いは自由度です。DALL·E 2は、OpenAIの管理下の元で運営されているため、自分の画像をトレーニングするような自由なことはできません。その反面、Stable Diffusionは、オープンソースという形のため、難易度も高くセキュリティー面でもなかなかハードルは高いのが現状です。

Midjourney

Midjourneyは、Stable Diffusionテクノロジーを使って独自に進化しているImage to Text AIモデルです。Midjourneyは、WEB上にUIがありませんのでDiscordで画像を作るようになります。Midjourneyの提供しているDiscordにアクセスし、Promptを打ち込むことでDiscord内で画像を既成することができます。

さまざまなチューニングがされているので、誰でも簡単に目を見張るような画像を作ることができますが、Midjourneyの管理下の元での運用のため、Stable Diffusionのような自由度はありません。また、Discordというアプリを起動させて使うということもあり、WEBから気軽にアクセスできるものではないため、非常にクローズなコミュニティーになっています。ただ、クローズな分より優れたアーティストたちも集まるので、質の高いものができるのも利点の1つです。